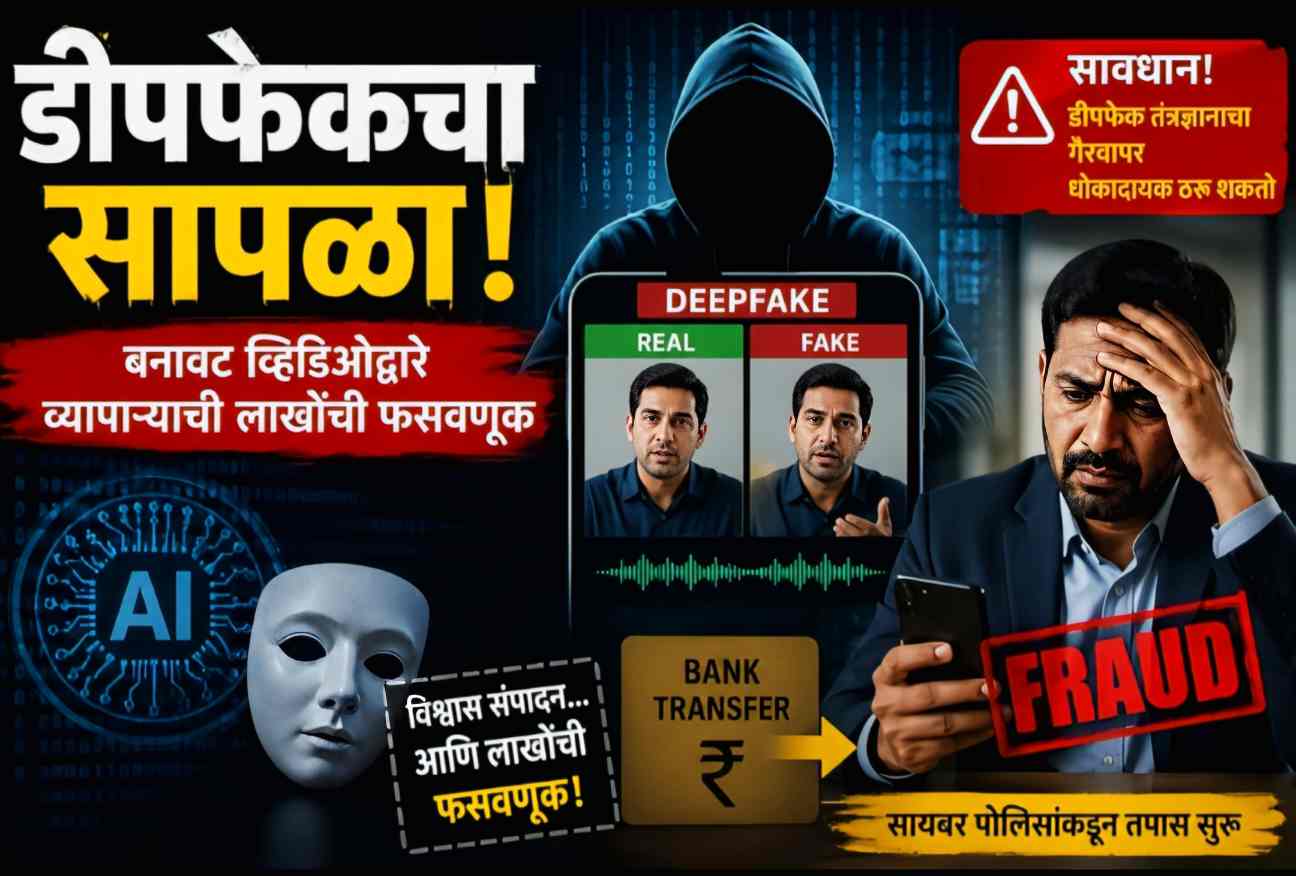

डीपफेकचा सापळा, बनावट व्हिडिओद्वारे व्यापाऱ्याची लाखोंची फसवणूक

AI तंत्रज्ञानाचा गैरवापर ; डीपफेक बनवून व्यापाऱ्याला गंडा

डीपफेक तंत्रज्ञानाचा वापर करून व्यापाऱ्याची लाखोंची फसवणूक झाल्याची धक्कादायक घटना समोर आली आहे. बनावट व्हिडिओ आणि आवाजाच्या मदतीने आरोपींनी विश्वास संपादन करत आर्थिक फसवणूक केली.

डिजिटल युगात तंत्रज्ञानाचा वेगाने वाढणारा वापर जितका फायदेशीर ठरत आहे तितकाच त्याचा गैरवापरही वाढताना दिसत आहे. अशाच प्रकारातील एक गंभीर घटना नुकतीच समोर आली असून डीपफेक (Deepfake) तंत्रज्ञानाचा वापर करून एका व्यापाऱ्याची लाखो रुपयांची फसवणूक करण्यात आली आहे.

मिळालेल्या माहितीनुसार आरोपींनी व्यापाऱ्याच्या ओळखीतील व्यक्तीचा बनावट व्हिडिओ आणि आवाज तयार केला.हा व्हिडिओ इतका वास्तवदर्शी होता की व्यापाऱ्याला तो खरा असल्याचा भास झाला.या माध्यमातून आरोपींनी तातडीची आर्थिक मदत मागितल्याचे सांगून व्यापाऱ्याला विश्वासात घेतले.

विश्वास बसल्यानंतर व्यापाऱ्याने कोणतीही खातरजमा न करता संबंधित खात्यावर मोठी रक्कम ट्रान्सफर केली. नंतर हा प्रकार लक्षात आल्यानंतर त्यांनी पोलिसांत धाव घेतली. सायबर पोलिसांनी गुन्हा दाखल करून तपास सुरू केला आहे.

तज्ज्ञांच्या मते, डीपफेक तंत्रज्ञानामुळे भविष्यात अशा फसवणुकींचे प्रमाण वाढण्याची शक्यता आहे. त्यामुळे नागरिकांनी कोणतीही आर्थिक व्यवहार करताना व्हिडिओ किंवा कॉलवर पूर्णपणे विश्वास न ठेवता प्रत्यक्ष पडताळणी करणे आवश्यक आहे.

सावधानतेसाठी सूचना:

अनोळखी किंवा संशयास्पद व्हिडिओ/कॉलवर विश्वास ठेवू नका

पैसे ट्रान्सफर करण्यापूर्वी व्यक्तीची खातरजमा करा

सायबर गुन्ह्यांची तक्रार त्वरित पोलिसांकडे करा

OTP, बँक डिटेल्स कोणालाही देऊ नका.